Open AI社のChatGPTは、2023年9月25日に「GPT-4V」の導入を発表しました。

「GPT-4V」の導入によってAIによる画像認識が可能となり、アップロードした画像を読み取ることが可能になりました。

本記事ではChatGPTの新機能であるGPT-4Vの使い方について詳しく解説していきます。

GPT-4Vを利用するための料金についても紹介するので、GPT-4Vに興味がある人はぜひ参考にしてください。

[su_note note_color=”#FEFFE0″]

AIを使って効率的にブログ記事・SEOコンテンツを作成したいのであればAItoolsを利用するのがおすすめです。

今なら5日間の無料トライアルもご用意しているので、AIライティングに興味がある人はぜひチェックしてください。

[/su_note]

GPT-4Vとは?

GPT-4Vとは、ChatGPTのAIモデルであるGPT-4に画像認識機能が追加されたモデルです。

「V」は「Vision(視覚)」を表しており、従来のテキスト情報だけでなく画像データを理解することが可能になりました。

例えば冷蔵庫の中身の写真をGPT-4Vにアップロードし、「この材料で何が作れますか?」と質問すれば、冷蔵庫の中身に応じて最適なレシピを提案してくれるような形です。

GPT-4Vの導入によって、ChatGPTの活用の幅がより広がったといえるでしょう。

GPT-4Vはいつから使える?

GPT-4Vはすでにリリースされており、有料版であるChatGPT Plusの契約者であれば利用可能です。

残念ながら無料版のChatGPTではGPT-4Vの機能を利用できません。

GPT-4Vの機能を利用したいのであれば、月額20ドルを支払ってChatGPT Plusの契約を行うようにしてください。

GPT-4Vの利用料金

GPT-4Vは月額20ドルを支払って「ChatGPT Plus」を契約すれば利用できるようになります。

また、すでに有料プランに加入しているユーザーであれば、何も手続きをせずにGPT-4Vが利用可能です。

ChatGPT Plusに加入するとGPT-4Vによる画像認識だけでなく、ブラウジング機能やGPTsなど様々な追加機能が使えます。

ChatGPTをより便利に使い倒したいのであれば、ChatGPT Plusへの加入を検討してください。

ChatGPT Plusの登録方法や料金体系については下記の記事で詳しく解説しています。

[surfing_other_article id=”2342″]

GPT-4Vの使い方事例7つ

[su_box title=”GPT-4Vの使い方事例7つ” box_color=”#339FDB”]

- 画像の内容を読み取る

- 画像から位置情報を特定する

- 写真撮影方法のアドバイス

- 食べ物画像からカロリー計算を行う

- 画像内の文章を翻訳する

- 図表やチャートが表す意味を読み取る

- Webサイトの画像からソースコードを作成する

[/su_box]

GPT-4Vの使い方の事例は上記7つです。

これからGPT-4Vを活用したいと考えているのであれば、上記の事例を参考にしてください。

ここからそれぞれの事例について、1つずつ詳しく解説していきます。

画像の内容を読み取る

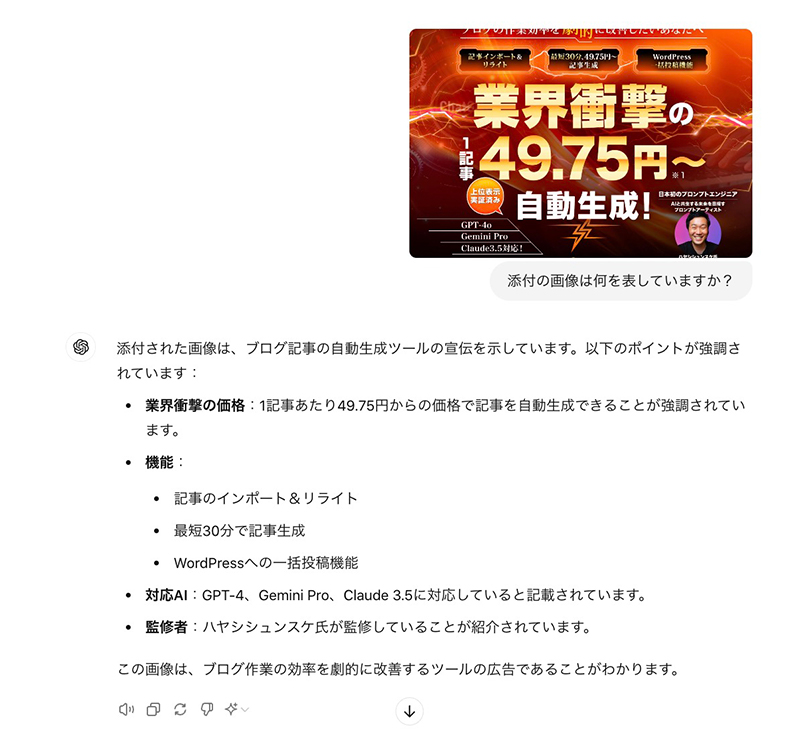

GPT-4Vを活用すれば、添付した画像の内容を読み取らせることが可能です。

人間の目では気づきにくいような細かい情報を読み取ることもできるため、画像に関する詳細情報を知りたいのであれば活用してみてください。

[su_box title=”プロンプト例” box_color=”#339FDB”]

添付の画像は何を表していますか?[/su_box]

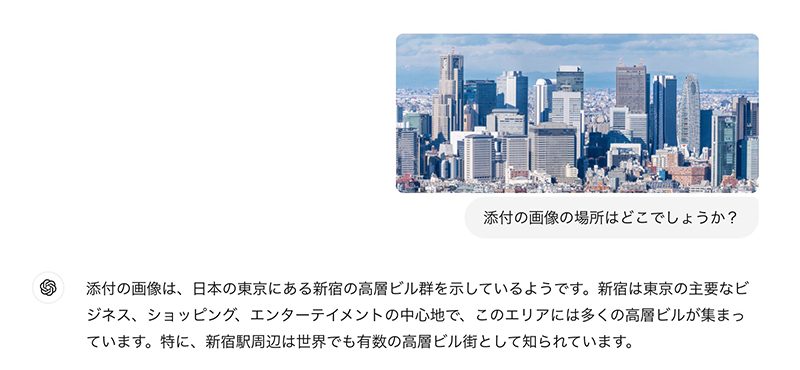

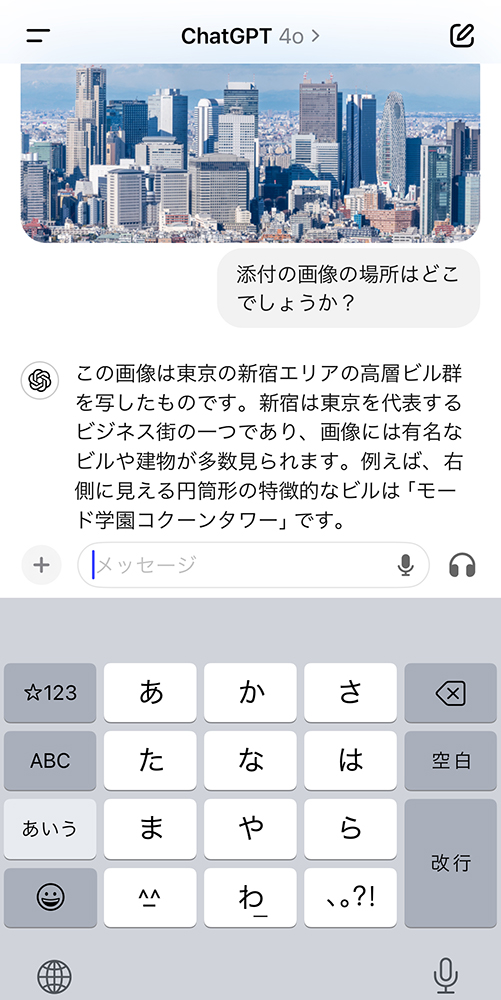

画像から位置情報を特定する

風景の写真を添付して、どの場所の画像なのかを推察・特定する機能もGPT-4Vには備わっています。

よほど地理に詳しい人でなければ、風景画像だけで位置情報を特定するのは難しいです。

ただし情報が少なすぎる風景画像だと「特定が難しい」という回答が返ってきてしまうため、注意してください。

[su_box title=”プロンプト例” box_color=”#339FDB”]

添付の画像の場所はどこでしょうか?[/su_box]

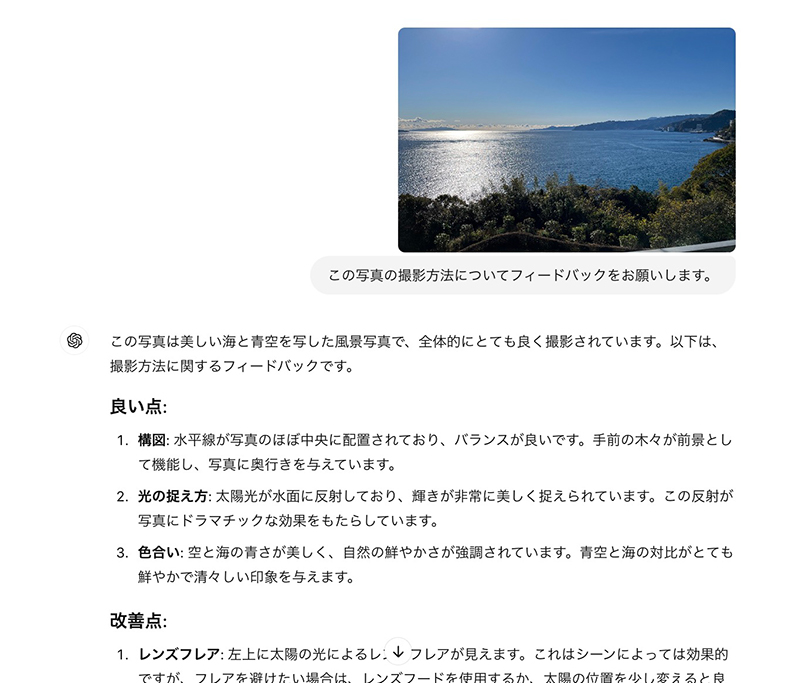

写真撮影方法のアドバイス

GPT-4Vを使えば、自分が撮影した写真の撮影方法をアドバイスしてもらうこともできます。

写真の撮影方法に関するアドバイスをもらう機会はあまりないので、ChatGPTにフィードバックをもらえば独学でも写真撮影が早く上達するでしょう。

[su_box title=”プロンプト例” box_color=”#339FDB”]

この写真の撮影方法についてフィードバックをお願いします。[/su_box]

改善点だけでなく良い点もフィードバックしてくれるのでありがたいですね。

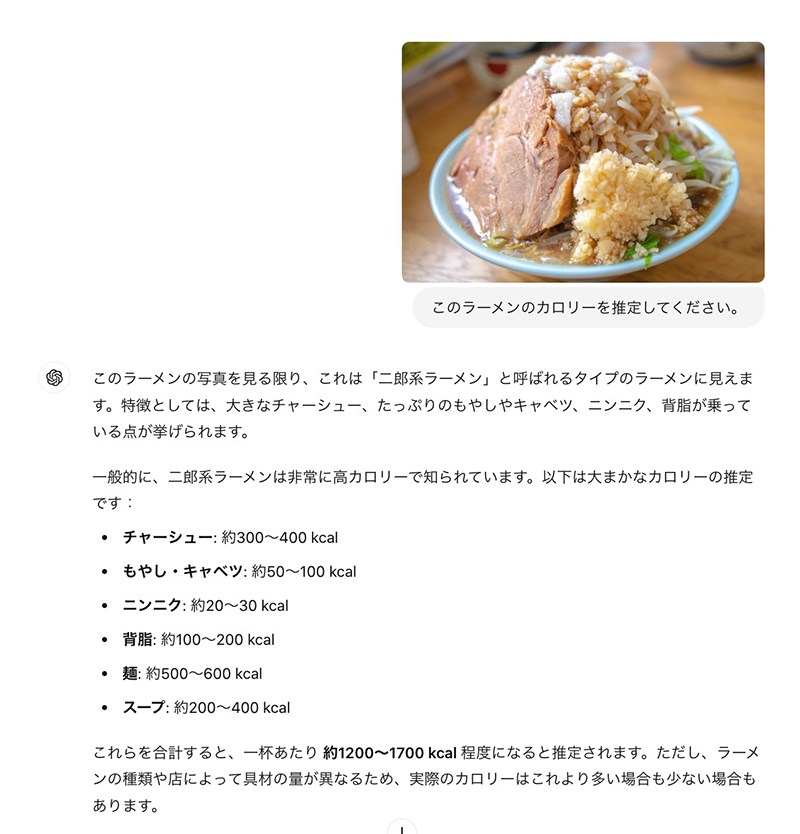

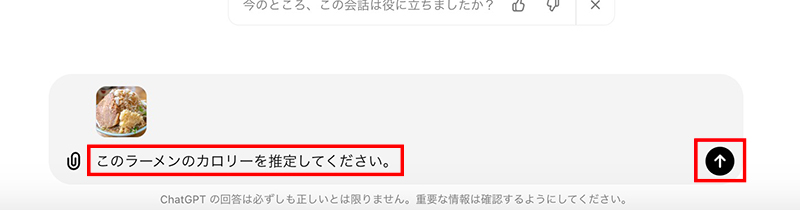

食べ物画像からカロリー計算を行う

GPT-4Vを使えば食べ物の画像からカロリー計算を行うことも可能です。

通常カロリー計算を行うには1つ1つの食材のカロリーを合計する必要がありますが、GPT-4Vであれば画像だけで大まかなカロリーを計算できます。

もしあなたがダイエットをしているのであれば、ぜひGPT-4Vでカロリー計算を行ってみてください。

[su_box title=”プロンプト例” box_color=”#339FDB”]

このラーメンのカロリーを推定してください。[/su_box]

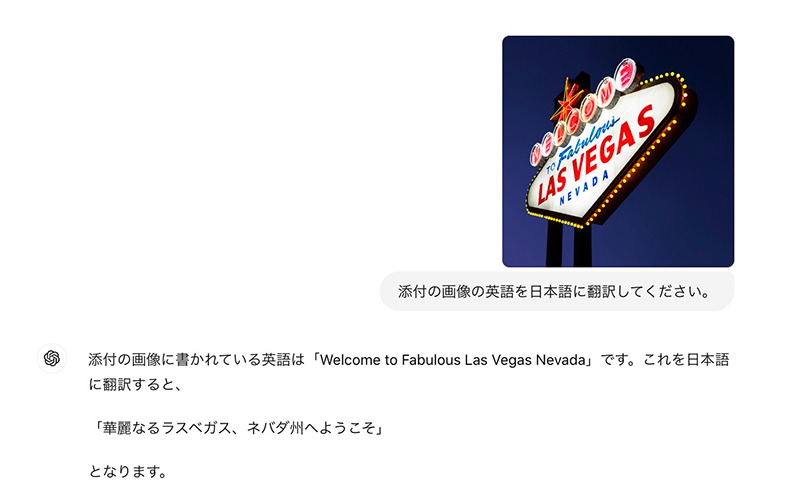

画像内の文章を翻訳する

GPT-4Vを使えば、画像内の文字を認識して文章を翻訳することができます。

もともとChatGPTの翻訳精度は高いので、画像認識機能が追加されたことでより強力な翻訳ツールになったといえるでしょう。

[su_box title=”プロンプト例” box_color=”#339FDB”]

添付の画像の英語を日本語に翻訳してください。[/su_box]

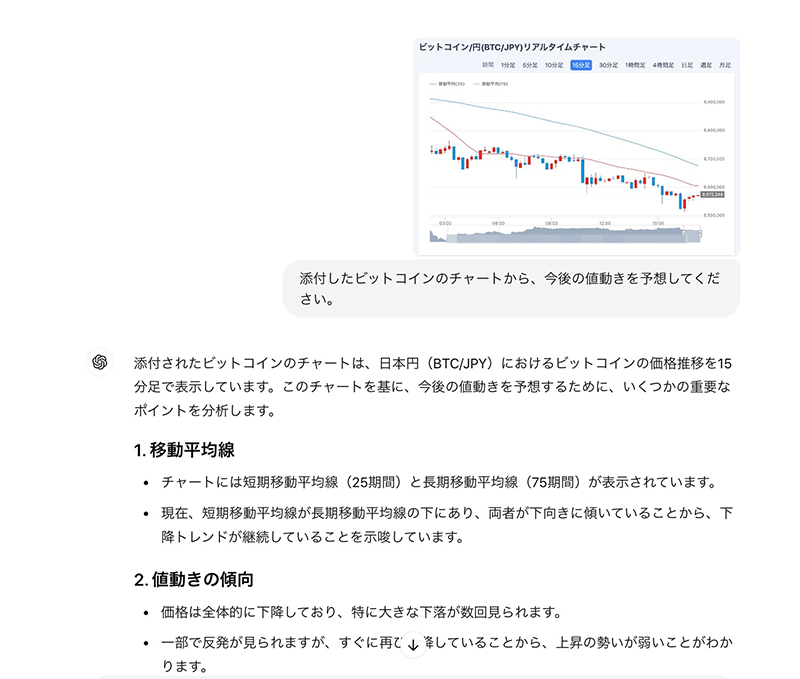

図表やチャートが表す意味を読み取る

GPT-4Vを使えば、株価など図表やチャートを分析させて意味を読み取らせることも可能です。

図表やチャートの画像を添付し、質問を行えば画像データを元に分析結果を説明してくれます。

株や仮想通貨のトレーダーに向いている機能だといえるでしょう。

ただし場合によっては精度にムラがあるため、チャート分析を行う際には補助的に利用するのがおすすめです。

[su_box title=”プロンプト例” box_color=”#339FDB”]

添付したビットコインのチャートから、今後の値動きを予想してください。[/su_box]

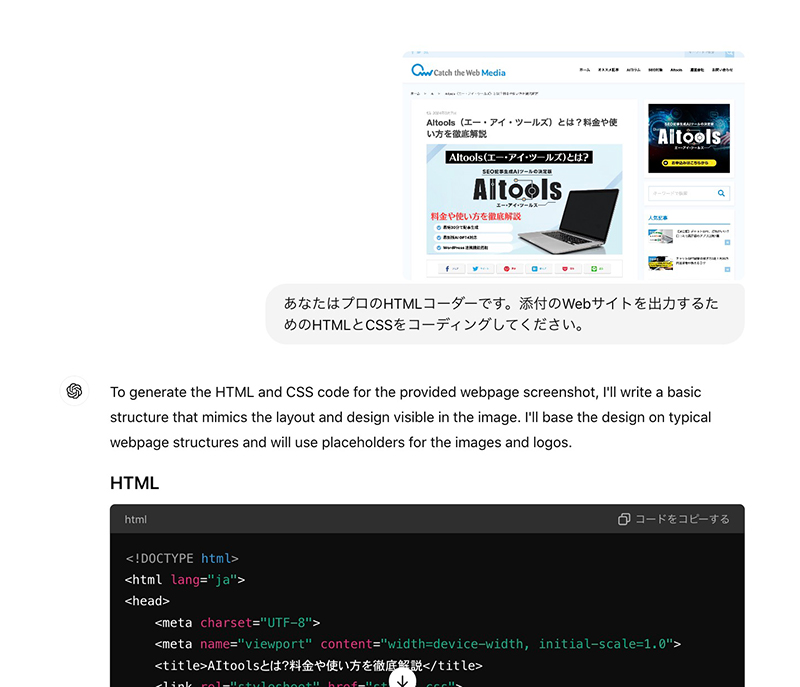

Webサイトの画像からソースコードを作成する

GPT-4Vを使えばWebサイトの画像からソースコードを作成することも可能です。

Web制作を行っていて「このWebサイトと似ているサイトを作るためのコードが知りたい」というときに活用できるでしょう。

細かい部分は人間の手で調整する必要はありますが、大枠のデザインをAIで作れるのは制作時間の短縮につながる可能性が高いです。

[su_box title=”プロンプト例” box_color=”#339FDB”]

あなたはプロのHTMLコーダーです。添付のWebサイトを出力するためのHTMLとCSSをコーディングしてください。[/su_box]

GPT-3.5とGPT-4Vの違う点は?

| GPT-3.5 | GPT-4V | |

|---|---|---|

| 費用 | 無料 | 月額20ドル |

| 利用可能AIモデル |

|

|

| AIの精度 | 普通 | 高い |

| 画像認識 | × | ◯ |

| GPTs(旧プラグイン) | × | ◯ |

| ブラウジング機能 | × | ◯ |

GPT-3.5とGPT-4Vの違いについて、上記の比較表にまとめました。

GPT-3.5は無料で利用できるAIモデルであり、精度的にはやや低めに設定されています。

対してGPT-4Vは月額20ドルの費用がかかりますが、精度の高いAIモデルであるGPT-4oや画像認識、GPTsなど様々な機能を利用可能です。

より精度の高いAIを利用したい人や、画像認識やブラウジングなどの機能を利用したい人はGPT-4Vを検討してください。

GPT-4Vの始め方

GPT-4Vの始め方を詳しく解説していきます。

[su_note note_color=”#ffffff”]

- PCからの利用方法

- スマホからの利用方法

[/su_note]

デバイスごとに使い方を解説するので、これからGPT-4Vを使ってみたい人はぜひ参考にしてください。

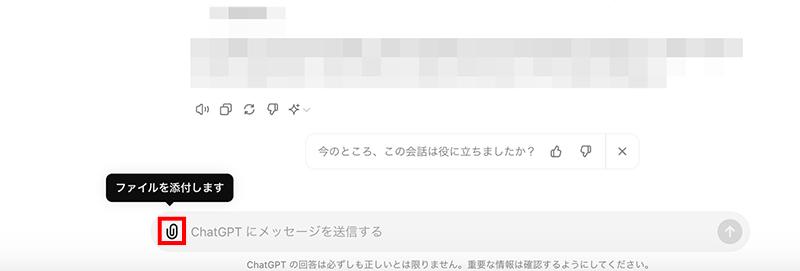

PCからの利用方法

PCからGPT-4Vを利用するには、ブラウザ版のChatGPTを開いてください。

有料版のChatGPT Plusを契約していれば、左上のモデル選択メニューの中に「GPT-4o」が表示されるので、選択します。

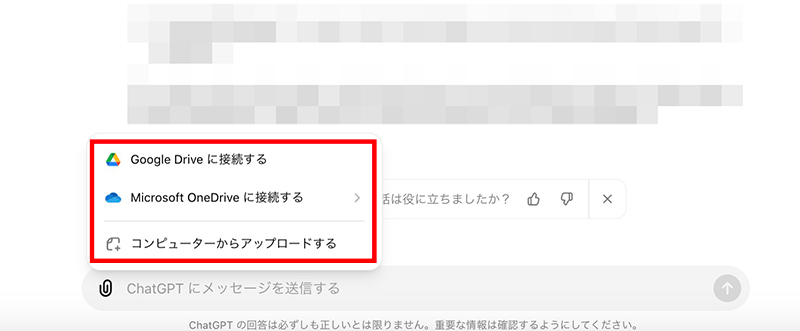

プロンプト入力欄の左側にファイル添付アイコンがあるため、クリックして画像を添付しましょう。

画像の参照先を選択します。

今回は「コンピューターからアップロードする」を選択しました。

画像ファイルを添付すれば、プロンプト入力欄に画像が反映されます。

あとはプロンプトを入力すれば、画像を参考にした出力を得ることが可能です。

PCからGPT-4Vを利用する際には、上記の手順で行ってみてください。

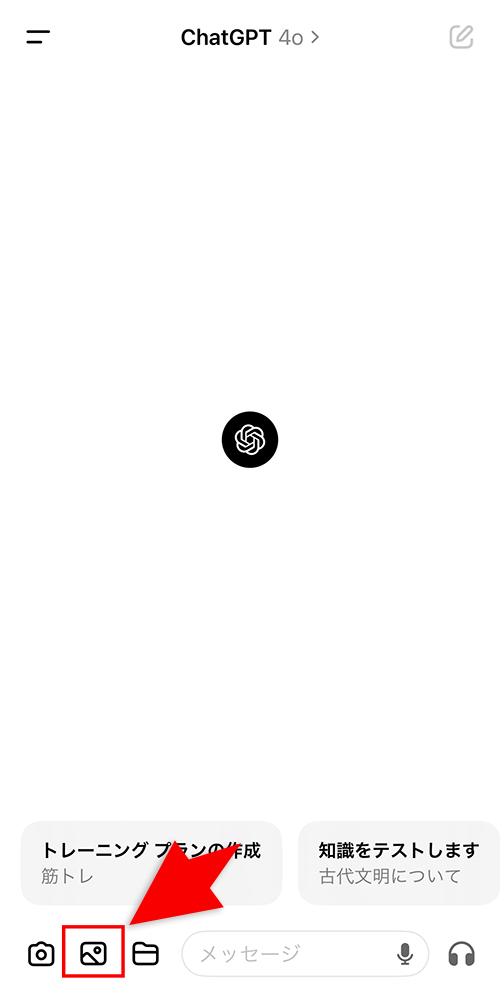

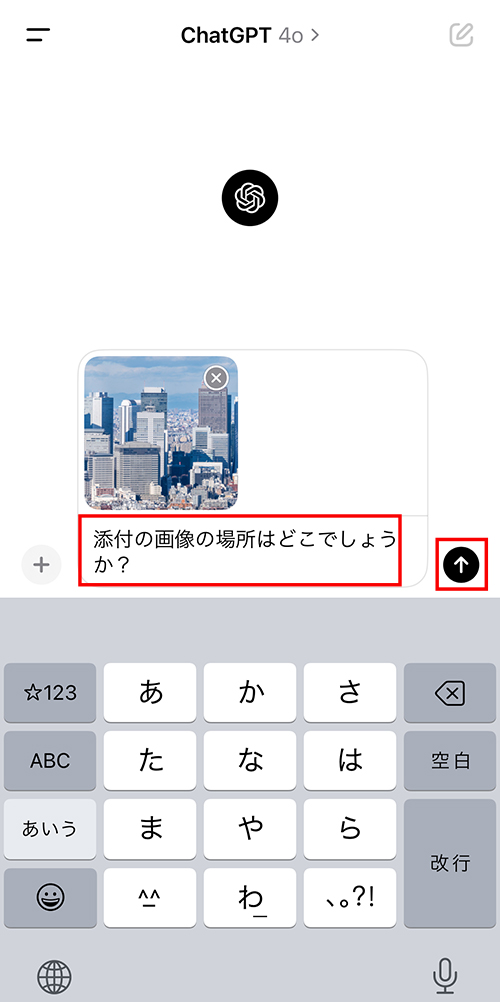

スマホからの利用方法

スマホからGPT-4Vを利用するためには、ChatGPTアプリをインストールする必要があります。

画面上のAIモデル選択メニューより、「GPT-4o」を選択してください。

続いて、画面左下のファイルアイコンをタップします。

スマホ内に保存されている画像からAIに認識させたい画像を選択してください。

あとはプロンプトを入力し、入力アイコンをタップします。

このように画像を参考にして質問をすることが可能です。

スマホでGPT-4Vを利用したいのであれば、上記の手順で操作を行ってください。

GPT-4Vを使用する上での注意点

[su_box title=”GPT-4Vを使用する上での注意点” box_color=”#339FDB”]

- 誤った情報が出力される可能性がある

- 画像の品質が悪いと正確な認識ができない

[/su_box]

GPT-4Vを利用する上での注意点は上記の通り。

ここからそれぞれのポイントについて、1つずつ詳しく解説していきます。

誤った情報が出力される可能性がある

画像を添付してAIに質問を行った場合、ChatGPTから誤った情報が出力される可能性があります。

AIの回答は必ずしも情報が正しいとは限らないので、出力された情報が本当に合っているのかを確認するようにしてください。

これはGPT-4Vに限らず、すべてのAIに共通の注意点になります。

AIを利用する際には、情報の正確性のチェックを欠かさないようにしましょう。

画像の品質が悪いと正確な認識ができない

ChatGPTに添付する画像の品質が悪いと正確な認識ができない点も注意してください。

画質の粗い画像データを読み込ませた場合、正確な判断ができずに間違った情報が出力される可能性が高くなるでしょう。

ChatGPTに画像データを読み込ませる際には、できるだけ鮮明で高解像度の画像を利用するようにしてください。

GPT-4Vに関するQ&A

[su_box title=”GPT-4Vに関するQ&A” box_color=”#339FDB”]

- GPT-4とGPT-4Vの違いは?

- GPT-4VのAPI料金は?

- GPT-4Vで画像生成はできる?

[/su_box]

GPT-4Vに関するよくある疑問は上記の通り。

ここからそれぞれの疑問について、1つずつ詳しく解説します。

GPT-4とGPT-4Vの違いは?

| GPT-4 | GPT-4V | |

|---|---|---|

| 費用 | 月額20ドル | 月額20ドル |

| パラメーター | 1,000億個 | 2,000億個 |

| コンテキスト・サイズ | 約3,000単語 | 約5,000単語 |

| 画像認識 | × | ◯ |

| 音声認識 | × | ◯ |

GPT-4とGPT-4Vの違いについて、上記の比較表にまとめました。

GPT-4VはGPT-4の進化バージョンであり、今までは難しかった画像や音声データの読み込みが可能です。

テキストだけでなく画像や音声を参考に質問ができるため、GPT-4Vを使えば幅広いAI活用ができるでしょう。

GPT-4VのAPI料金は?

| 入力1Mトークン | 10.00ドル |

|---|---|

| 出力1Mトークン | 30.00ドル |

GPT-4VのAPI料金は上記の通り。

GPT-4Vの機能を自社ツールに組み込みたい場合などは、APIを活用するのも検討してください。

GPT-4Vで画像生成はできる?

GPT-4Vで画像生成を行うことはできません。

GPT-4Vは画像を認識できるAIモデルのため、画像を生成できるのは「DALL・E3」のモデルです。

「DALL・E3」も有料版のChatGPT Plusであれば利用できるため、AIを使って画像生成を行いたい人はぜひ使ってみてください。

ChatGPTで画像生成を行う方法については下記の記事で詳しく解説しています。

[surfing_other_article id=”575″]

まとめ:GPT-4Vの使い方や料金を理解しましょう

ここまでGPT-4Vの使い方や料金について詳しく解説してきました。

GPT-4VはChatGPTに新しく追加されたAIモデルであり、画像や音声データの認識も可能になっています。

画像を参考にした質問を行うことができるため、よりAI活用の幅が広がったといえるでしょう。

ぜひ本記事の内容を参考にしていただき、GPT-4Vを使いこなしてください。

[su_note note_color=”#FEFFE0″]

最新AIを使って効率的にブログ記事・SEOコンテンツを作成したいのであればAItoolsを利用するのがおすすめです。

今なら5日間の無料トライアルもご用意しているので、AIライティングに興味がある人はぜひチェックしてください。

[/su_note]